原文鏈接:https://fuckcloudnative.io/posts/deploy-k3s-cross-public-cloud/

TCP 重置攻擊 是使用一個單一的數據包來執行的,只有幾個字節大小。攻擊者製作併發送一個偽造的 TCP 重置包來干擾用戶和網站的連接,欺騙通信雙方終止 TCP 連接。我們偉大的 xx 長城便運用了這個技術來進行 TCP 關鍵字阻斷。

理解 TCP 重置攻擊並不需要具備深厚的網絡知識功底,只需要一台筆記本就可以對自己進行模擬攻擊。本文將會帶你了解 TCP 重置攻擊的原理,同時會幫助你理解很多關於 TCP 協議的特性。本文主要內容:

- 回顧 TCP 協議的基礎知識

- 了解 TCP 重置攻擊的原理

- 使用一個簡單的

Python腳本來模擬攻擊

下面開始分析 TCP 重置攻擊原理。

1. 偉大的 xx 長城是如何利用 TCP 重置攻擊的?

這一段略過,原因你懂得,感興趣的請直接看原文。

2. TCP 重置攻擊的工作原理

在 TCP 重置攻擊中,攻擊者通過向通信的一方或雙方發送偽造的消息,告訴它們立即斷開連接,從而使通信雙方連接中斷。正常情況下,如果客戶端收發現到達的報文段對於相關連接而言是不正確的,TCP 就會發送一個重置報文段,從而導致 TCP 連接的快速拆卸。

TCP 重置攻擊利用這一機制,通過向通信方發送偽造的重置報文段,欺騙通信雙方提前關閉 TCP 連接。如果偽造的重置報文段完全逼真,接收者就會認為它有效,並關閉 TCP 連接,防止連接被用來進一步交換信息。服務端可以創建一個新的 TCP 連接來恢復通信,但仍然可能會被攻擊者重置連接。萬幸的是,攻擊者需要一定的時間來組裝和發送偽造的報文,所以一般情況下這種攻擊只對長連接有殺傷力,對於短連接而言,你還沒攻擊呢,人家已經完成了信息交換。

從某種意義上來說,偽造 TCP 報文段是很容易的,因為 TCP/IP 都沒有任何內置的方法來驗證服務端的身份。有些特殊的 IP 擴展協議(例如 IPSec)確實可以驗證身份,但並沒有被廣泛使用。客戶端只能接收報文段,並在可能的情況下使用更高級別的協議(如 TLS)來驗證服務端的身份。但這個方法對 TCP 重置包並不適用,因為 TCP 重置包是 TCP 協議本身的一部分,無法使用更高級別的協議進行驗證。

儘管偽造 TCP 報文段很容易,但偽造正確的 TCP 重置報文段並完成攻擊卻並不容易。為了理解這項工作的難度,我們需要先了解一下 TCP 協議的工作原理。

3. TCP 協議工作原理

TCP 協議的目標是向客戶端發送一份完整的數據副本。例如,如果我的服務器通過 TCP 連接向你的計算機發送我的網站的 HTML,你的計算機的 TCP 協議棧應該能夠以我發送的形式和順序輸出 HTML。

然而現實生活中我的 HTML 內容並不是按順序發送的,它被分解成許多小塊(稱為 TCP 分組),每個小塊在網絡上被單獨發送,並被重新組合成原來發送的順序。這種重新組合后的輸出被稱為 TCP 字節流。

將分組重建成字節流並不簡單,因為網絡是不可靠的。TCP分組可能會被丟棄,可能不按發送的順序到達客戶端,也可能會被重複發送、報文損壞等等。因此,TCP 協議的職責是在不可靠的網絡上提供可靠的通信。TCP 通過要求連接雙方保持密切聯繫,持續報告它們接收到了哪些數據來實現可靠通信,這樣服務端就能夠推斷出客戶端尚未接收到的數據,並重新發送丟失的數據。

為了進一步理解這個過程,我們需要了解服務端和客戶端是如何使用序列號(sequence numbers)來標記和跟蹤數據的。

TCP 序列號

TCP 協議的通信雙方, 都必須維護一個序列號(sequence numbers),對於客戶端來說,它會使用服務端的序列號來將接收到的數據按照發送的順序排列。

當通信雙方建立 TCP 連接時,客戶端與服務端都會向對方發送一個隨機的初始序列號,這個序列號標識了其發送數據流的第一個字節。TCP 報文段包含了 TCP 頭部,它是附加在報文段開頭的元數據,序列號就包含在 TCP 頭部中。由於 TCP 連接是雙向的,雙方都可以發送數據,所以 TCP 連接的雙方既是發送方也是接收方,每一方都必須分配和管理自己的序列號。

確認應答

當接收方收到一個 TCP 報文段時,它會向發送方返回一個 ACK 應答報文(同時將 TCP 頭部的 ACK 標誌位置 1),這個 ACK 號就表示接收方期望從發送方收到的下一個字節的序列號。發送方利用這個信息來推斷接收方已經成功接收到了序列號為 ACK 之前的所有字節。

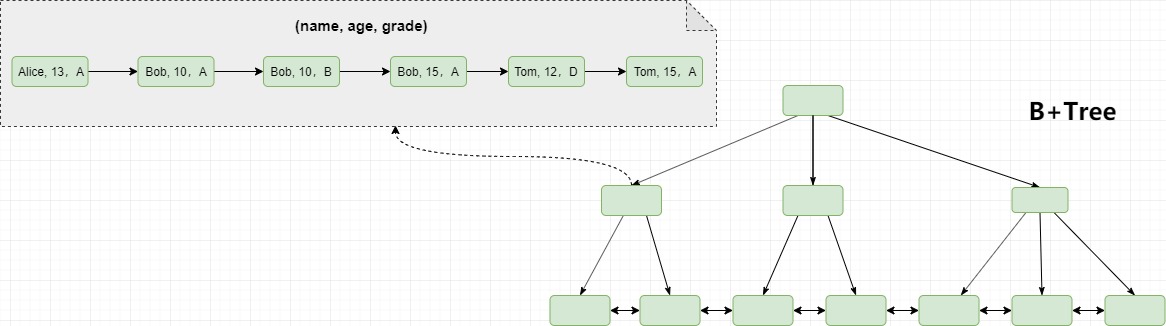

TCP 頭部格式如下圖所示:

一個確認應答報文的 TCP 頭部必須包含兩個部分:

- ACK 標誌位置位 1

- 包含確認應答號(ACK number)

TCP 總共有 6 個標誌位,下文就會講到其中的 RST 標誌位。

TCP 頭部包含了多個選項,其中有一個選擇確認選項(

SACK),如果使用該選項,那麼當接收方收到了某個範圍內的字節而不是連續的字節時,就會發送SACK告知對方。例如,只收到了字節1000~3000和4000~5000,但沒有收到3001~3999。為了簡單起見,下文討論 TCP 重置攻擊時將忽略選擇確認選項。

如果發送方發送了報文後在一段時間內沒有收到 ACK,就認為報文丟失了,並重新發送報文,用相同的序列號標記。這就意味着,如果接收方收到了重複的報文,可以使用序列號來判斷是否見過這個報文,如果見過則直接丟棄。網絡環境是錯綜複雜的,往往並不是如我們期望的一樣,先發送的數據包,就先到達目標主機,反而它很騷,可能會由於網絡擁堵等亂七八糟的原因,會使得舊的數據包,先到達目標主機。一般分兩種情況:

- 發送的數據包丟失了

- 發送的數據包被成功接收,但返回的 ACK 丟失了

這兩種情況對發送方來說其實是一樣的,發送方並不能區分是哪種情況,所以只能重新發送數據包。

只要不頻繁重複發送數據,額外的開銷基本可以忽略。

為偽造的重置包選擇序列號

構建偽造的重置包時需要選擇一個序列號。接收方可以接收序列號不按順序排列的報文段,但這種容忍是有限度的,如果報文段的序列號與它期望的相差甚遠,就會被直接丟棄。

因此,一個成功的 TCP 重置攻擊需要構建一個可信的序列號。但什麼才是可信的序列號呢?對於大多數報文段(除了重置包,即 RST 包)來說,序列號是由接收方的接收窗口大小決定的。

TCP 滑動窗口大小

想象一下,將一台上世紀 90 年代初的古老計算機,連接到現代千兆光纖網絡。閃電般快速的網絡可以以令人瞠目結舌的速度向這台古老的計算機傳送數據,速度遠遠超過該計算機的處理能力。但並沒有什麼卵用,因為只有接收方接收並處理了報文,才能認為這個報文已經被收到了。

TCP 協議棧有一個緩衝區,新到達的數據被放到緩衝區中等待處理。但緩衝區的大小是有限的,如果接收方的處理速度跟不上發送方的發送速度,緩衝區就會被填滿。一旦緩衝區被填滿,多餘的數據就會被直接丟棄,也不會返回 ACK。因此一旦接收方的緩衝區有了空位,發送方必須重新發送數據。也就是說,如果接收方的處理速度跟不上,發送方的發送速度再快也沒用。

緩衝區到底有多大?發送方如何才能知道什麼時候可以一次發送更多的數據,什麼時候該一次發送很少的數據?這就要靠 TCP 滑動窗口了。接收方的滑動窗口大小是指發送方無需等待確認應答,可以持續發送數據的最大值。 假設接收方的通告窗口大小為 100,000 字節,那麼發送方可以無需等待確認應答,持續發送 100,000 個字節。再假設當發送方發送第 100,000 個字節時,接收方已經發送了前 10,000 個字節的 ACK,這就意味着窗口中還有 90,000 個字節未被確認,發送方還可以再持續發送 10,000 個字節。如果發送了 10,000 個字節的過程中沒有收到任何的 ACK,那麼接收方的滑動窗口將被填滿,發送方將停止發送新數據(可以繼續發送之前丟失的數據),直到收到相關的 ACK 才可以繼續發送。

TCP 連接雙方會在建立連接的初始握手階段通告對方自己窗口的大小,後續還可以動態調整。TCP 緩衝區大的服務器可能會聲明一個大窗口,以便最大限度提高吞吐量。TCP 緩衝區小的服務器可能會被迫聲明一個小窗口,這樣做會犧牲一定的吞吐量,但為了防止接收方的 TCP 緩衝區溢出,還是很有必要的。

換個角度來看,TCP 滑動窗口大小是對網絡中可能存在的未確認數據量的硬性限制。我們可以用它來計算髮送方在某一特定時間內可能發送的最大序列號(max_seq_no):

max_seq_no = max_acked_seq_no + window_size

其中 max_acked_seq_no 是接收方發送的最大 ACK 號,它表示發送方知道接收方已經成功接收的最大序列號。window_size 是窗口大小,它表示允許發送方最多發送的未被確認的字節。所以發送方可以發送的最大序列號是:max_acked_seq_no + window_size。

TCP 規範規定,接收方應該忽略任何序列號在接收窗口之外的數據。例如,如果接收方確認了所有序列號在 15,000 以下的字節,且接收窗口大小為 30,000,那麼接下來接收方只能接收序列號範圍在 15,000 ~ 45,000 之間的數據。如果一個報文段的部分數據在窗口內,另一部分數據在窗口外,那麼窗口內的數據將被接收確認,窗口外的數據將被丟棄。注意:這裏忽略了選擇確認選項,再強調一遍!

對於大多數 TCP 報文段來說,滑動窗口的規則告訴了發送方自己可以接收的序列號範圍。但對於重置報文來說,序列號的限制更加嚴格,這是為了抵禦一種攻擊叫做盲目 TCP 重置攻擊(blind TCP reset attack),下文將會解釋。

TCP 重置報文段的序列號

對於 TCP 重置報文段來說,接收方對序列號的要求更加嚴格,只有當其序列號正好等於下一個預期的序列號時才能接收。繼續搬出上面的例子,接收方發送了一個確認應答,ACK 號為 15,000。如果接下來收到了一個重置報文,那麼其序列號必須是 15,000 才能被接收。

如果重置報文的序列號超出了接收窗口範圍,接收方就會直接忽略該報文;如果其序列號在接收窗口範圍內,那麼接收方就會返回一個 challenge ACK,告訴發送方重置報文段的序列號是錯誤的,並告之正確的序列號,發送方可以利用 challenge ACK 中的信息來重新構建和發送重置報文。

其實在 2010 年之前,TCP 重置報文段和其他報文段的序列號限制規則一樣,但無法抵禦盲目 TCP 重置攻擊,後來才採取這些措施施加額外的限制。

盲目 TCP 重置攻擊

如果攻擊者能夠截獲通信雙方正在交換的信息,攻擊者就能讀取其數據包上的序列號和確認應答號,並利用這些信息得出偽裝的 TCP 重置報文段的序列號。相反,如果無法截獲通信雙方的信息,就無法確定重置報文段的序列號,但仍然可以批量發出盡可能多不同序列號的重置報文,以期望猜對其中一個序列號。這就是所謂的盲目 TCP 重置攻擊(blind TCP reset attack)。

在 2010 年之前 TCP 的原始版本中,攻擊者只需要猜對接收窗口內的隨便哪一個序列號即可,一般只需發送幾萬個報文段就能成功。採取額外限制的措施后,攻擊者需要發送數以百萬計的報文段才有可能猜對序列號,這幾乎是很難成功的。更多細節請參考 RFC-5963。

4. 模擬攻擊

以下實驗是在

OSX系統中完成的,其他系統請自行測試。

現在來總結一下偽造一個 TCP 重置報文要做哪些事情:

- 嗅探通信雙方的交換信息。

- 截獲一個

ACK標誌位置位 1 的報文段,並讀取其ACK號。 - 偽造一個 TCP 重置報文段(

RST標誌位置為 1),其序列號等於上面截獲的報文的ACK號。這隻是理想情況下的方案,假設信息交換的速度不是很快。大多數情況下為了增加成功率,可以連續發送序列號不同的重置報文。 - 將偽造的重置報文發送給通信的一方或雙方,時其中斷連接。

為了實驗簡單,我們可以使用本地計算機通過 localhost 與自己通信,然後對自己進行 TCP 重置攻擊。需要以下幾個步驟:

- 在兩個終端之間建立一個 TCP 連接。

- 編寫一個能嗅探通信雙方數據的攻擊程序。

- 修改攻擊程序,偽造併發送重置報文。

下面正式開始實驗。

建立 TCP 連接

可以使用 netcat 工具來建立 TCP 連接,這個工很多操作系統都預裝了。打開第一個終端窗口,運行以下命令:

$ nc -nvl 8000

這個命令會啟動一個 TCP 服務,監聽端口為 8000。接着再打開第二個終端窗口,運行以下命令:

$ nc 127.0.0.1 8000

該命令會嘗試與上面的服務建立連接,在其中一個窗口輸入一些字符,就會通過 TCP 連接發送給另一個窗口並打印出來。

嗅探流量

編寫一個攻擊程序,使用 Python 網絡庫 scapy 來讀取兩個終端窗口之間交換的數據,並將其打印到終端上。完整的代碼參考我的 GitHub 倉庫,代碼的核心是調用 scapy 的嗅探方法:

t = sniff(

iface='lo0',

lfilter=is_packet_tcp_client_to_server(localhost_ip, localhost_server_port, localhost_ip),

prn=log_packet,

count=50)

這段代碼告訴 scapy 在 lo0 網絡接口上嗅探數據包,並記錄所有 TCP 連接的詳細信息。

- iface : 告訴 scapy 在

lo0(localhost)網絡接口上進行監聽。 - lfilter : 這是個過濾器,告訴 scapy 忽略所有不屬於指定的 TCP 連接(通信雙方皆為

localhost,且端口號為8000)的數據包。 - prn : scapy 通過這個函數來操作所有符合

lfilter規則的數據包。上面的例子只是將數據包打印到終端,下文將會修改函數來偽造重置報文。 - count : scapy 函數返回之前需要嗅探的數據包數量。

發送偽造的重置報文

下面開始修改程序,發送偽造的 TCP 重置報文來進行 TCP 重置攻擊。根據上面的解讀,只需要修改 prn 函數就行了,讓其檢查數據包,提取必要參數,並利用這些參數來偽造 TCP 重置報文併發送。

例如,假設該程序截獲了一個從(src_ip, src_port)發往 (dst_ip, dst_port)的報文段,該報文段的 ACK 標誌位已置為 1,ACK 號為 100,000。攻擊程序接下來要做的是:

- 由於偽造的數據包是對截獲的數據包的響應,所以偽造數據包的源

IP/Port應該是截獲數據包的目的IP/Port,反之亦然。 - 將偽造數據包的

RST標誌位置為 1,以表示這是一個重置報文。 - 將偽造數據包的序列號設置為截獲數據包的 ACK 號,因為這是發送方期望收到的下一個序列號。

- 調用

scapy的send方法,將偽造的數據包發送給截獲數據包的發送方。

對於我的程序而言,只需將這一行取消註釋,並註釋這一行的上面一行,就可以全面攻擊了。按照步驟 1 的方法設置 TCP 連接,打開第三個窗口運行攻擊程序,然後在 TCP 連接的其中一個終端輸入一些字符串,你會發現 TCP 連接被中斷了!

進一步實驗

- 可以繼續使用攻擊程序進行實驗,將偽造數據包的序列號加減 1 看看會發生什麼,是不是確實需要和截獲數據包的

ACK號完全相同。 - 打開

Wireshark,監聽 lo0 網絡接口,並使用過濾器ip.src == 127.0.0.1 && ip.dst == 127.0.0.1 && tcp.port == 8000來過濾無關數據。你可以看到 TCP 連接的所有細節。 - 在連接上更快速地發送數據流,使攻擊更難執行。

總的來說,TCP 重置攻擊既深奧又簡單,祝你實驗順利。

Kubernetes 1.18.2 1.17.5 1.16.9 1.15.12離線安裝包發布地址http://store.lameleg.com ,歡迎體驗。 使用了最新的sealos v3.3.6版本。 作了主機名解析配置優化,lvscare 掛載/lib/module解決開機啟動ipvs加載問題, 修復lvscare社區netlink與3.10內核不兼容問題,sealos生成百年證書等特性。更多特性 https://github.com/fanux/sealos 。歡迎掃描下方的二維碼加入釘釘群 ,釘釘群已經集成sealos的機器人實時可以看到sealos的動態。

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※網頁設計一頭霧水該從何著手呢? 台北網頁設計公司幫您輕鬆架站!

※網頁設計公司推薦不同的風格,搶佔消費者視覺第一線

※Google地圖已可更新顯示潭子電動車充電站設置地點!!

※廣告預算用在刀口上,台北網頁設計公司幫您達到更多曝光效益

※別再煩惱如何寫文案,掌握八大原則!

※網頁設計最專業,超強功能平台可客製化